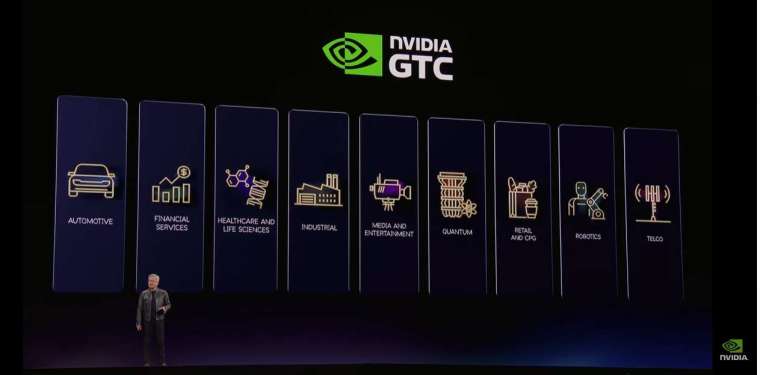

全球AI 迷引颈期盼「AI 界超级杯」来了,在2026 年辉达GTC 大会主题演讲中,辉达执行长黄仁勋勾勒出人工智慧产业下一阶段的发展蓝图,并提出多项新技术与长期布局,显示AI 基础设施正从晶片竞赛进一步走向完整的运算生态系。

辉达2027 年先进AI 晶片商机达1 兆美元

去年10 月辉达曾预估Blackwell 与Rubin AI 平台带来的营收可见度超过5000 亿美元,黄仁勋在演讲中公布更惊人的营收预期。

黄仁勋表示,Blackwell 与Vera Rubin 两代AI 晶片至2027 年的整体营收机会至少达1 兆美元,显示全球企业与新创公司对AI 算力需求仍然强劲。此消息引发辉达尾盘一度急升,但随后有所回落,收高约1.4%。

黄仁勋提出「代币工厂(Token Factory)」概念,认为未来资料中心的角色将从传统资料储存设施,转变为生产AI 推理代币的智慧工厂。

辉达强调,透过高度整合的硬体与软体协同设计,其系统能大幅降低单位代币成本,使企业未来必须像管理资产一样管理「代币产出率」。

Vera Rubin 架构与Groq 技术结合

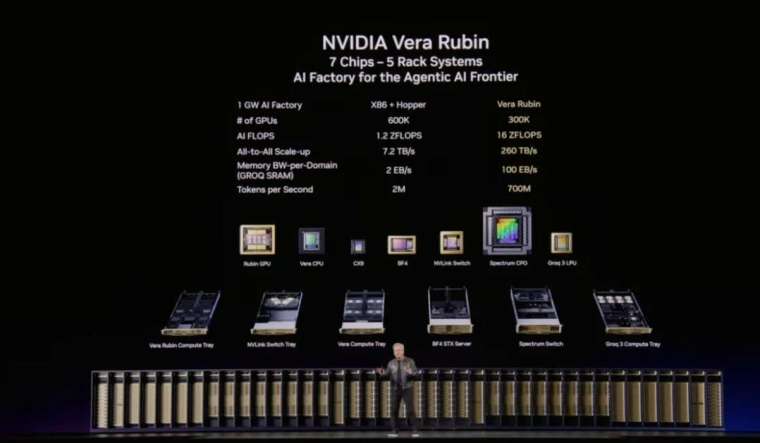

辉达新一代AI 基础设施平台Vera Rubin,整合七款晶片与五种机架系统,打造专为「代理 AI」(Agentic AI) 设计的超级运算平台。

黄仁勋认为:「代理式AI 的转折点已经到来,Vera Rubin 将开启历史上最大规模的基础设施建设浪潮。」

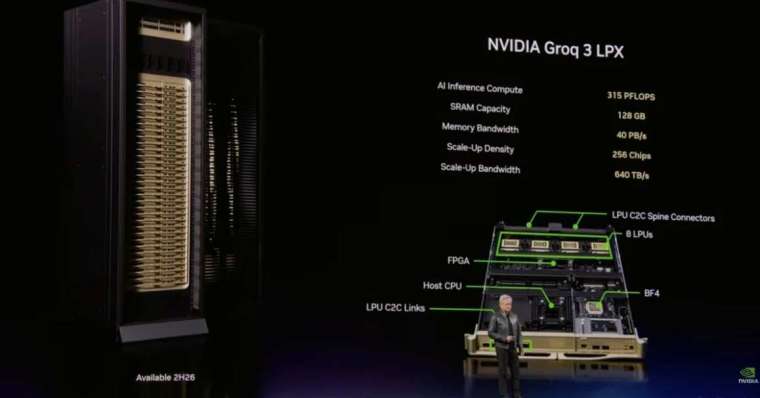

根据黄仁勋公布的最新产品蓝图,辉达在与AI 晶片新创公司Groq 建立合作关系后,已将Groq 的LPU(语言处理单元) 纳入长期产品规画。

Vera Rubin 平台整合Vera CPU、Rubin GPU、NVLink 6 交换器、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6 乙太网路交换器,以及Groq 3 LPU 推论加速器,形成完整AI 工厂架构。

Groq 3 LPX 机架主打低延迟推论与百万Token 级上下文处理能力,与Rubin GPU 协同运算时,推论吞吐量最高可提升35 倍。

Vera Rubin 平台已获AWS、Google Cloud、微软Azure、Oracle Cloud、CoreWeave 等云端业者支持,思科、戴尔、HPE、联想与广达、纬创、鸿海、华硕、技嘉等硬体厂也将推出相关系统。

辉达表示,基于Vera Rubin 架构的产品预计自2026 年下半年起陆续上市。

辉达发布全新Vera CPU

除了GPU,辉达也强调自身在CPU 领域的布局,发布全新Vera CPU,定位为「全球首款专为代理式AI 与强化学习设计的处理器」,并作为Vera Rubin AI 平台的核心运算中枢。

Vera CPU 采用88 个自研Olympus 核心,专门处理代理式AI 的任务规划、资料调用、程式执行与结果验证等逻辑工作,整体结果产出效率提升2 倍、运行速度提升约50%。

黄仁勋表示,新推出的Vera CPU 在单执行绪效能、资料输出与资料处理能力方面表现突出,同时具备极高的能源效率。

他指出,Vera CPU 的设计目标是与Vera Rubin 平台的机架系统整合,支援代理式AI 的大规模运算需求。

Vera CPU 透过NVLink-C2C 技术与Rubin GPU 连接,提供最高1.8 TB/s 传输频宽,是PCIe Gen6 的约7 倍,强化CPU 与GPU 的协同运算能力。

包括阿里巴巴、字节跳动、Meta、Oracle、CoreWeave 等云端业者,以及Dell、HPE、联想、华硕、技嘉、广达、纬创等硬体厂商均计划导入Vera CPU。

Vera CPU 的推出意味辉达正从GPU 供应商转型为完整AI 基础设施平台商,并对英特尔与AMD 主导的伺服器CPU 市场形成正面竞争。

加入OpenClaw 热潮推出NeMoClaw

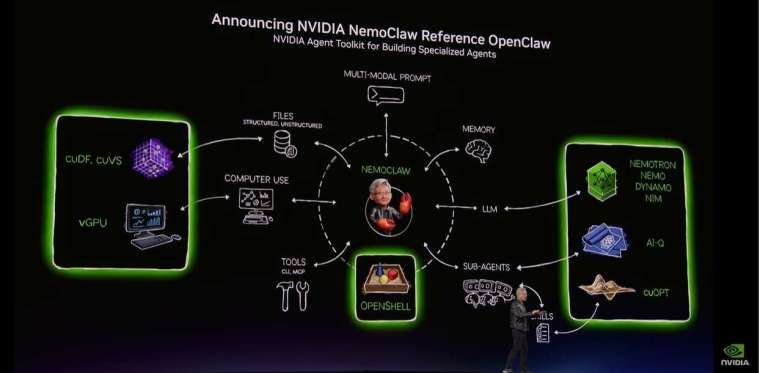

开源AI 代理OpenClaw(此前称为Clawdbot 与Moltbot) 自去年秋季推出后迅速在开发者社群爆红,如今辉达也正式加入这股浪潮。

黄仁勋宣布推出NemoClaw 开源企业级AI 代理平台,强调该平台将为OpenClaw 生态提供隐私与安全机制,包括整合OpenShell,同时降低企业导入AI 代理系统的门槛。

黄仁勋表示,如今全球企业都需要制定OpenClaw 策略,也就是建立代理式AI 系统(agentic system) 的策略。

未来软体产业将逐步从SaaS(软体即服务) 转向AaaS(智慧体即服务) 的新模式。

物理AI 爆发从自动驾驶到「雪宝」现身

黄仁勋在演讲中也展示实体AI 的快速发展,并指出自动驾驶技术已进入大规模商用阶段。

辉达RoboTaxi Ready 平台新增比亚迪、现代与吉利等汽车制造商合作伙伴,相关平台未来可涵盖每年约1,800 万辆新车。同时,辉达也与Uber 达成合作部署计画。

黄仁勋演说会场一大亮点之一,是迪士尼机器人角色「雪宝」(Olaf) 登场,展示透过Omniverse 与Newton 物理解算器在虚拟世界中训练后,机器人如何具备更强的物理适应与动作能力。

Feynman (费曼) 平台

辉达预计2028 年推出次世代加速运算平台Feynman (费曼),将首次采用裸晶(die) 堆叠设计,并整合客制化高频宽记忆体(HBM)。

同时,系统将透过NVLink 技术与LP40 LPU 互连,强化与GPU 之间的协同运算效率。

Feynman 世代也将导入名为Rosa 的新一代CPU,并搭配下一代BlueField-5 DPU,还将进一步扩展光电融合架构。

近期市场热议辉达在大型AI 系统互连技术上究竟会选择光纤还是铜缆。黄仁勋在演讲中给出简单答案:「两者都会用。」

黄仁勋称,Feynman 将首次同时采用铜缆与共封装光学(co-packaged optics) 进行系统扩展,以增加更多AI 推论所需传输频宽。

太空运算布局

辉达的布局已不再局限于地球上的资料中心,而是将目光延伸至太空运算基础设施。

辉达推出为太空设计的硬体,像是Space-1 Vera Rubin 平台,采用全新AI 加速运算架构,相较NVIDIA H100 可实现25 倍的太空AI 运算能力。

黄仁勋表示,未来辉达希望在太空建造资料中心。由于地球上土地与能源供应逐渐成为限制,一些科技企业正探索将资料中心部署在太空的可能性。

不过黄仁勋也坦言,这项计画面临巨大技术挑战。

他指出,在太空环境中没有热传导与对流,只有辐射散热,因此如何为太空资料中心设计有效的冷却系统,将成为关键问题。